Trong những năm gần đây, các mô hình ngôn ngữ lớn (Large Language Models – LLM) đã trở thành một dạng nền tảng cho các mô hình trí tuệ nhân tạo (AI). Tuy nhiên, thách thức là việc xây dựng và huấn luyện các LLM mới không phải là một bài toán dễ dàng. Dịch vụ đám mây LLM là một giải pháp cho vấn đề này.

Tại hội nghị Nvidia GTC, công ty đã đưa ra một hàng loạt các thông báo bao gồm các hoạt động AI trên nhiều ngành công nghiệp. Một trong những thông báo quan trọng mà Nvidia đưa ra là về một loạt các khả năng LLM mới, bao gồm các Dịch vụ đám mây LLM nhằm cho phép nhiều tổ chức và cá nhân hơn tạo, đào tạo và hưởng lợi từ LLM.

“Chúng tôi đang công bố Dịch vụ NeMo LLM để cho phép tùy chỉnh và sử dụng các mô hình AI khổng lồ,” Paresh Kharya, giám đốc cấp cao của các sản phẩm máy tính tăng tốc tại Nvidia, nói. “Giống như cách LLM có thể hiểu ngôn ngữ của con người, họ cũng đã được đào tạo để hiểu ngôn ngữ của sinh học và hóa học.”

Tại sao LLM lại quan trọng

LLM dựa trên kiến trúc biến áp AI và được sử dụng rộng rãi để hỗ trợ trong thực tế cuộc sống ngày càng tăng.

Kharya giải thích rằng với một Transformer, mô hình AI có thể hiểu phần nào của một câu, một hình ảnh hoặc thậm chí các điểm dữ liệu rất khác nhau có liên quan đến nhau. Không giống như mạng nơ-ron phức hợp (CNN), thường chỉ xem xét các mối quan hệ trực tiếp, máy biến áp cũng được thiết kế nhằm đào tạo các mối quan hệ xa hơn, điều mà Kharya nói là rất quan trọng đối với các trường hợp sử dụng như xử lý ngôn ngữ tự nhiên (NLP).

Ông nói: “Transformer cũng cho phép chúng tôi đào tạo trên các tập dữ liệu không được gắn nhãn và điều đó mở rộng đáng kể khối lượng dữ liệu. “Chúng tôi đang chứng kiến sự bùng nổ của việc nghiên cứu, áp dụng các mô hình Transformer cho hầu hết các ứng dụng thực tế trong năm nay. Chúng tôi dự kiến sẽ có 11.000 bài nghiên cứu về các Transformer, thực tế là tăng gấp bảy lần so với năm năm trước ”.

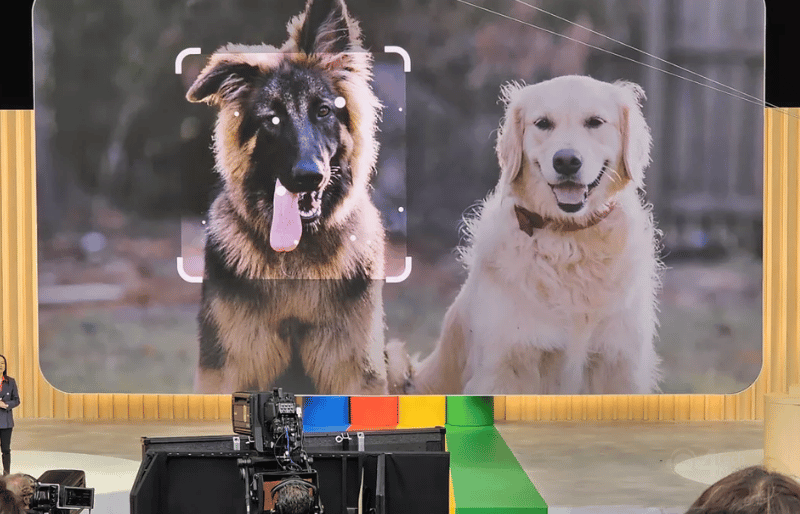

GPT-3 LLM đã giúp nâng cao nhận thức và áp dụng LLM cho nhiều trường hợp sử dụng khác nhau, bao gồm tóm tắt và tạo văn bản. LLM cũng là nền tảng của công nghệ chuyển đổi văn bản thành hình ảnh DALL-E.

“Ngày nay, chúng ta đang thấy LLM được áp dụng để dự đoán cấu trúc protein từ các chuỗi axit amin hoặc để hiểu và tạo ra tác phẩm nghệ thuật bằng cách tìm hiểu mối quan hệ giữa các pixel”, Kharya nói.

Học tập kịp thời và nhu cầu về ngữ cảnh cho LLMs

Như với bất kỳ loại mô hình AI nào, ngữ cảnh là vấn đề quan trọng. Điều gì có thể có ý nghĩa đối với một đối tượng hoặc trường hợp sử dụng sẽ không phù hợp với đối tượng khác. Đào tạo LLM hoàn toàn mới cho mọi loại trường hợp sử dụng là một quá trình tốn nhiều thời gian.

Kharya nói rằng một cách tiếp cận mới nổi để cung cấp ngữ cảnh cho LLM cho các trường hợp sử dụng cụ thể là một kỹ thuật được gọi là học nhanh . Ông giải thích rằng với việc học hỏi nhanh chóng, một mô hình đồng hành được đào tạo để học cách cung cấp ngữ cảnh cho mô hình ngôn ngữ lớn được đào tạo trước, sử dụng cái được gọi là mã thông báo nhắc nhở.

Mô hình đồng hành có thể tìm hiểu ngữ cảnh bằng cách sử dụng ít nhất 100 ví dụ về truy vấn có phản hồi phù hợp. Vào cuối quá trình đào tạo học tập nhanh chóng, một mã thông báo được tạo ra sau đó có thể được sử dụng cùng với truy vấn, sẽ cung cấp ngữ cảnh được yêu cầu từ LLM.

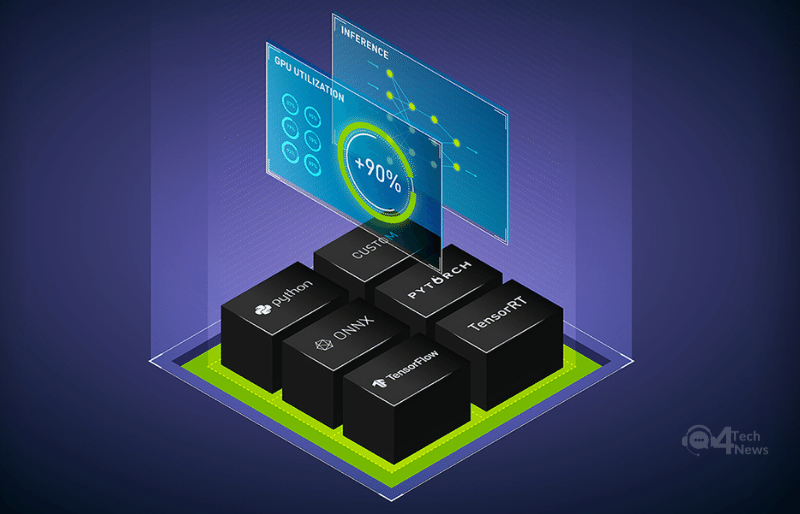

Dịch vụ Nvidia NeMo LLM hỗ trợ những gì

Dịch vụ NeMo LLM mới là một nỗ lực giúp việc tùy chỉnh và sử dụng các mô hình AI khổng lồ trở nên dễ dàng hơn.

Các mô hình AI khổng lồ mà dịch vụ sẽ hỗ trợ bao gồm mô hình dựa trên GPT 5 tỷ và 20 tỷ tham số, cũng như một mô hình dựa trên LLM chứa 530 tỷ Megatron . Là một phần của dịch vụ, Nvidia cũng đang hỗ trợ điều chỉnh dựa trên học tập để kích hoạt nhanh chóng các ứng dụng theo ngữ cảnh cụ thể. Kharya nói rằng Dịch vụ NeMo LLM cũng sẽ bao gồm tùy chọn sử dụng cả mô hình làm sẵn và mô hình tùy chỉnh thông qua trải nghiệm API dựa trên đám mây.

Tiến thêm một bước nữa, Nvidia có khả năng cũng đang tung ra các Dịch vụ đám mây LLM cụ thể cho khoa học, đời sống với Dịch vụ BioNeMo.

“Giống như cách một LLM có thể hiểu được ngôn ngữ của con người, họ cũng đã được đào tạo để hiểu ngôn ngữ của sinh học và hóa học,” Kharya nói.

Kharya nói rằng, ví dụ, DNA là ngôn ngữ về cơ bản được viết bằng bảng chữ cái của axit nucleic và ngôn ngữ của cấu trúc protein được viết bằng bảng chữ cái của axit amin.

Nhìn chung, mục tiêu của các Dịch vụ đám mây LLM mới là để mở rộng hơn nữa việc sử dụng AI.

“Tiềm năng và khả năng thực sự vô cùng lớn nữa đó là khả năng tiếp cận các mô hình ngôn ngữ lớn và khả năng tùy chỉnh chúng dễ dàng hơn mà trước đây chưa có,” Kharya nói. “Vì vậy, những gì Dịch vụ mô hình ngôn ngữ lớn NeMo đem lại sẽ loại bỏ rào cản đó và cho phép mọi người truy cập và trải nghiệm các Dịch vụ đám mây LLM cho các ứng dụng của họ.”

(Theo Sean Michael Kerner)